“Per assicurare un ambiente online a misura di minore, una rilevante responsabilità spetta ai fornitori di servizi. In tal senso, il GDPR ha previsto la necessità di assicurare ai minori una specifica protezione e, nel Regno unito, per agevolare gli operatori in questo compito, il legislatore ha imposto all’Autorità di controllo privacy (Information Commissioner’s Office, ICO) di adottare un apposito code of practice, da ultimo entrato in vigore lo scorso 2 settembre con la denominazione “Age-appropriate design code” o, più semplicemente, “Children’s code”[1].

Il Children’s code (nel seguito indicato anche come “il Codice”) non mira a proteggere i minori dal mondo digitale, bensì ad assicurare loro una protezione all’interno di questo mondo[2], fermo restando che il costo dell’innovazione digitale non può essere la privacy dei bambini[3].

Indice degli argomenti

Bambini e ragazzi online: opportunità e responsabilità

Bambini e ragazzi possono godere, nell’ambiente online, di contenuti e servizi idonei a massimizzare le esigenze di sviluppo della loro personalità. Al contempo, la presenza in rete del minore e delle sue tracce digitali (cioè, i suoi dati personali) espongono la sua persona, i suoi diritti e le sue libertà fondamentali a un ampio ventaglio di rischi (tra cui: pedopornografia, adescamento e conseguenti reati incidenti anche sull’integrità fisica, cyberbullismo, manipolazione a fini economici, politici o di altro tipo ecc.).

Un servizio online può essere adeguato ai minori solo se sia anche conforme al quadro normativo sulla protezione dei dati personali. La principale normativa in materia, il GDPR, considera il minore come una persona vulnerabile e il trattamento dei suoi dati come fattore che aumenta i rischi per i diritti e le libertà delle persone fisiche[4]. In tal senso, il considerando 38 del GDPR prevede che «i minori meritano una specifica protezione relativamente ai loro dati personali, in quanto possono essere meno consapevoli dei rischi, delle conseguenze e delle misure di salvaguardia interessate, nonché dei loro diritti in relazione al trattamento dei dati personali».

Per assicurare la protezione del minore in rete, un ruolo fondamentale spetta anzitutto ai genitori, in virtù dei doveri giuridici di cura, assistenza morale e educazione dei figli[5]. Altrettanto importante è il compito delle istituzioni di sviluppare, sia nei genitori sia in bambini e ragazzi, la consapevolezza dei rischi della rete, dell’importanza della protezione dei dati personali e dei diritti previsti in materia.

Questi fattori, tuttavia, risultano insufficienti per garantire la sicurezza del minore su Internet. Nel contesto online, infatti, genitori e ragazzi incontrano difficoltà che spesso impediscono di compiere scelte informate o di esercitare un reale controllo sui dati[6]. Questa situazione è dovuta a una pluralità di cause, tra cui: l’opacità e la complessità delle privacy policy dei servizi, lo squilibrio di potere tra utenti e fornitori, le posizioni di fatto dominanti dei principali attori del mercato. Ne deriva che, spesso, la scelta dell’utente si riduce al prendere o lasciare: o si accettano le condizioni dei servizi rinunciando alle esigenze di protezione del minore (eventualità che potrebbe essere fonte di responsabilità civile per i genitori) o si priva il minore dei benefici della rete, con il rischio di esporre quest’ultimo a pregiudizi ulteriori (es. esclusione sociale).

Tutela dei minori o privacy? Europa alla ricerca di un complesso equilibrio

Il Children’s code

Il Codice risulta di grande importanza per tutti gli enti e le aziende sottoposti al regime del GDPR che offrono servizi online utilizzati da minori (siti web, social media, giochi online, app, smart toys ecc.), a prescindere dall’applicabilità del Codice nei loro confronti (vd. infra. par. 2.2.). Questi operatori, infatti, sono comunque obbligati a garantire la tutela rafforzata del minore richiesta dal GDPR e il Children’s code risulta in tal senso un prezioso supporto, perché agevola il compito di individuare le misure da progettare e implementare a tale scopo. La conformità al Codice, inoltre, costituisce rilevante elemento di accountability (consentendo di comprovare il rispetto virtuoso di diversi principi e obblighi del GDPR – vd. infra) e può rappresentare un vantaggio competitivo per le aziende, perché permette di rafforzare la fiducia dei genitori nei servizi offerti, dimostrando di tenere in seria considerazione la privacy di bambini e ragazzi.

Finalità e caratteristiche

Il Children’s code fornisce le indicazioni necessarie a progettare servizi online adeguati all’utilizzo da parte del minore d’età e coerenti con le esigenze di sviluppo di quest’ultimo.

La conformità al Codice permette di assicurare la specifica protezione del minore imposta dal GDPR e, come espressamente indicato dall’ICO, agevola il rispetto delle seguenti norme del Regolamento europeo:

- art. 5, par. 1, lett. a), principi di liceità, correttezza e trasparenza;

- art. 5, par. 1, lett. b), principio di limitazione della finalità;

- art. 5, par. 1, lett. c), principio di minimizzazione;

- art. 5, par. 1, lett. e), principio di limitazione della conservazione;

- art. 5, par. 2 GDPR, principio di responsabilizzazione;

- art. 6, liceità del trattamento;

- artt. 12-14, diritti di informazione;

- artt. 15-20, diritti dell’interessato;

- art. 22, profilazione e processi decisionali automatizzati;

- art. 25, protezione dei dati by design e by default;

- art. 35, valutazione d’impatto sulla protezione dei dati[7].

Il Codice è funzionale anche al rafforzamento della libertà di espressione, di pensiero, di coscienza e di associazione e, inoltre, mira a proteggere il minore da informazioni o contenuti lesivi per il suo benessere, nonché da forme di sfruttamento economico, sessuale o di altro tipo[8].

Il Children’s code è composto da 15 standard interdipendenti, da rispettare cumulativamente – nei limiti in cui siano rilevanti rispetto al singolo caso – per garantire la protezione del minore e la correttezza dei trattamenti svolti. In sintesi, gli standard mirano ad assicurare il miglior accesso possibile ai servizi online, riducendo contestualmente al minimo la raccolta e l’uso dei dati di bambini e ragazzi[9].

Accesso dei minori ai servizi digitali: soluzioni per tutelare privacy e sicurezza

Ogni standard è accompagnato da una sezione di approfondimento, che ne spiega l’importanza esemplificando scenari concreti e possibili modalità implementative. L’unica parte prescrittiva del Codice, tuttavia, è costituita dal testo degli standard – caratteristica dovuta all’approccio basato sul rischio e conforme al canone della proporzionalità scelto dall’ICO (e coerente con l’impostazione di fondo del GDPR). Gli standard, infatti, sono principi e funzioni privacy caratterizzati da neutralità tecnologica e consentono un’implementazione flessibile: le singole soluzioni tecniche potranno (e dovranno) essere differenti per ogni servizio, a seconda delle sue peculiarità[10]. Spetta agli operatori effettuare le valutazioni in tal senso necessarie e documentare le ragioni che ne rappresentano il fondamento.

In conformità ai principi di protezione dei dati by design e by default, gli standard devono essere innestati nei processi di sviluppo dei servizi fin dalla fase di progettazione, nonché nei successivi processi di aggiornamento e – laddove necessario – nel processo della DPIA.

I fornitori obbligati al rispetto del Codice

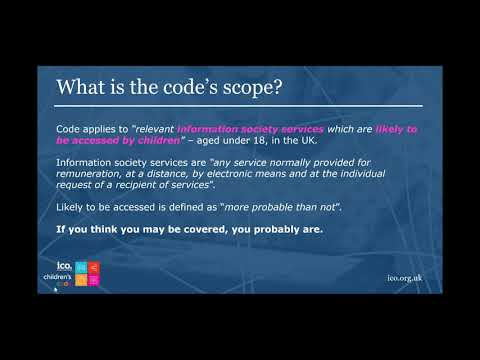

Sono obbligati al rispetto del Codice solo i fornitori dei servizi che abbiano le specifiche caratteristiche previste dal Data Protection Act 2018 e che siano assoggettati a quest’ultima normativa[11].

In particolare, il Codice si applica solo ai Servizi della Società dell’Informazione (nel seguito: “ISS”), nel caso in cui questi servizi:

- prevedano trattamenti di dati personali assoggettati al GDPR;

- potrebbero essere acceduti da minori (cioè, da persone di età inferiore a 18 anni)[12].

Come noto, sono ISS i servizi prestati normalmente dietro retribuzione, a distanza, per via elettronica e a richiesta individuale di un destinatario di servizi[13]. In sostanza, sono ISS molti siti web (streaming di contenuti, giochi online, social media, giornali online, marketplace ecc.), così come lo sono le app, nonché i giochi e gli altri dispositivi connessi. Occorre ricordare che sono ISS anche i servizi in cui la “retribuzione” non proviene direttamente dall’utente (es. i giochi online o le app offerti gratuitamente, ma che basano il loro modello di business sulla pubblicità). Anche i servizi di tipo educativo potrebbero essere considerati ISS, mentre il Codice non si applica ai servizi di prevenzione o consulenza forniti direttamente a un minore.

Per limitare possibili zone d’ombra in cui il minore rimarrebbe sprovvisto di protezione, l’applicazione del Codice è stata prevista, oltre che per i servizi rivolti ai minori, anche per quelli che potrebbero essere utilizzati dagli stessi. Per individuare queste ipotesi, occorre considerare:

- la natura e i contenuti del servizio, nonché l’eventualità che esso abbia un particolare appeal per i ragazzi;

- le modalità di accesso al servizio e le misure predisposte per prevenire l’uso da parte dei minori.

Al riguardo, se un operatore desidera offrire un servizio esclusivamente a un pubblico adulto, non è tenuto al rispetto del Codice, ma deve adottare le misure necessarie a limitare l’accesso da parte dei minori.

Come anticipato, il Codice si applica solo agli operatori assoggettati al Data Protection Act 2018, cioè:

- gli enti UK;

- quelli non UK che abbiano una filiale, ufficio o stabilimento nel Regno Unito, purché trattino dati personali nel contesto delle attività di tale sede;

- anche in mancanza di una filiale, gli enti stabiliti in territorio non UE/SEE che offrano servizi a utenti UK (o monitorino il comportamento di questi).

Gli operatori con una sede in Paese UE/SEE diverso dal Regno Unito non sono tenuti al rispetto del Codice, ma dovranno rispettare le norme di integrazione del GDPR previste dallo Stato in cui hanno sede.

Minori, come pubblicare foto e video di eventi senza violazioni privacy

Preme evidenziare come l’ICO ritenga che soltanto eccezionalmente il fornitore di un servizio utilizzato da minori potrebbe ritenersi non obbligato al rispetto del Codice[14]. In quest’eventualità, peraltro, occorrerà dimostrare le ragioni che indicano l’inapplicabilità del Codice, in conformità ai doveri di responsabilizzazione (es. test sull’efficacia delle misure limitative dell’accesso).

Le conseguenze della violazione del Codice e le tempistiche per l’adeguamento

La normativa inglese prevede che l’autorità giudiziaria e l’ICO sono tenuti a considerare gli standard del Children’s code nella risoluzione di questioni per cui essi sono rilevanti[15]. In particolare, l’ICO deve considerare il Codice per verificare il rispetto del GDPR e delle norme nazionali in materia di privacy da parte dei fornitori di servizi online, nonché nell’utilizzo dei propri poteri (anche sanzionatori)[16]. In merito, si evidenzia come gli standard del Codice siano connessi a norme del GDPR la cui violazione è soggetta a sanzioni amministrative pecuniarie fino a venti milioni di euro o, per le imprese, fino al 4% del fatturato mondiale annuo, se superiore.

Coloro che non si conformeranno al Codice avranno maggiori difficoltà a dimostrare la correttezza dei trattamenti svolti e il rispetto del GDPR, appunto perché le previsioni del Codice sono direttamente connesse a norme del GDPR[17]. La sola conformità al Children’s code, in ogni caso, non è sufficiente per garantire il rispetto del quadro normativo in materia di protezione dei dati personali.

In ossequio al principio di responsabilizzazione, i fornitori dovranno delineare un “programma di accountability” guidato dal responsabile per la protezione dei dati (se presente). In tal senso, occorrerà prevedere idonee misure per dimostrare la conformità al Codice, ad esempio realizzando adeguate policy aziendali e verificandone l’effettiva efficacia, nonché curando la formazione del personale incaricato[18].

Alla luce della complessità del Children’s code, è stato previsto un periodo transitorio di 12 mesi (entro il 2 settembre 2021) per consentire ai soggetti obbligati di curarne la completa implementazione.

I 15 standard del Children’s code

Il primo standard fornisce la chiave di lettura dell’intero Codice e pone un principio da tenere sempre in debita considerazione per interpretare e applicare correttamente gli altri standard.

L’interesse superiore del fanciullo

L’interesse superiore del minore deve essere la considerazione preminente quando si progettano e sviluppano servizi online che potrebbero essere acceduti da un minore[19].

Lo standard ripropone il più importante precetto della principale fonte giuridica in materia di tutela del minore: la Convenzione di New York sui diritti del fanciullo del 20 novembre 1989[20], che riconosce in capo al minore – tra gli altri – i diritti fondamentali all’identità personale (art. 8), alla riservatezza e alla tutela della vita privata (art. 16). Nella specie, quest’ultimo diritto prevede che nessun fanciullo possa essere oggetto di interferenze arbitrarie o illegali nella sua vita privata, nella sua famiglia, nel suo domicilio o nella sua corrispondenza, né di affronti illegittimi al suo onore e alla sua reputazione.

Il criterio del superiore interesse impone di considerare il complesso delle esigenze, dei diritti e delle libertà fondamentali di cui è titolare il minore e, in particolare, di rispettare la dignità e il diritto all’autodeterminazione di quest’ultimo. Il Comitato ONU sui diritti dell’infanzia ha chiarito che la valutazione del superiore interesse deve ricomprendere anche la sicurezza del minore, cioè il suo diritto alla protezione contro ogni forma di violenza, anche psichica, nonché da forme di sfruttamento sessuale, economico e di altro tipo[21]. Queste indicazioni sono di particolare importanza per le piattaforme che si basano, anche in parte, sullo sfruttamento commerciale dei dati: lo stesso ICO ha espressamente indicato come sia improbabile che gli interessi commerciali di un operatore possano essere considerati più importanti del diritto del fanciullo alla privacy[22].

Questo standard, inoltre, impone agli operatori di supportare anche i genitori nel compito di proteggere e promuovere il superiore interesse dei figli.

Valutazione d’impatto sulla protezione dei dati (DPIA)

Il secondo standard prevede che gli operatori effettuino una DPIA per valutare e mitigare i rischi per i diritti e le libertà dei minori discendenti dal trattamento. In questa attività, in particolare, devono essere considerate le diverse fasce d’età, capacità ed esigenze di sviluppo dei minori e deve essere curata la conformità del processo di DPIA al Codice[23].

La necessità di effettuare la DPIA dipende dal rischio sussistente nel caso concreto (art. 35 GDPR). A ogni modo, occorre considerare che nell’elenco dell’ICO relativo alle ipotesi in cui la DPIA è obbligatoria figurano l’offerta diretta di servizi ai minori, nonché l’uso dei dati dei minori per fini di marketing, profilazione o altri processi decisionali automatizzati[24]. D’altronde, in Italia il Garante privacy ha imposto di svolgere la DPIA per tutti i trattamenti non occasionali di dati relativi a soggetti vulnerabili, minori inclusi[25].

Gli operatori non devono sottovalutare l’importanza strategica della DPIA, che consente di rafforzare la fiducia verso genitori e utenti. Per valorizzare al massimo questa opportunità, è essenziale coinvolgere genitori e ragazzi nel processo della DPIA (art. 35, par. 9 GDPR) e rendere pubblica la DPIA svolta (e i successivi aggiornamenti). Ulteriore suggerimento, è quello di arricchire la valutazione richiedendo il parere di esperti del settore (es. professionisti specializzati in psicologia dello sviluppo).

La sezione del Codice dedicata a questo standard reca informazioni di dettaglio sugli aspetti da considerare nello svolgimento della DPIA per i trattamenti che coinvolgono i minori e chiarisce come, in ogni caso, essa debba includere una spiegazione sulle modalità di adeguamento a ogni altro standard del Codice. Per agevolare gli operatori, è stato previsto un apposito template di DPIA (Children’s code, Annex D).

Age-appropriate application

Risulta necessario adottare un approccio basato sul rischio per individuare l’età dei singoli utenti che potrebbero accedere a un certo servizio e assicurare che gli standard del Codice siano applicati in modo effettivo ai minori che utilizzano quel servizio. Nel caso in cui non si riesca a stabilire l’età con un livello di certezza adeguato ai rischi derivanti dal trattamento per i diritti e le libertà del fanciullo, è necessario applicare il Codice indistintamente a tutti gli utenti del servizio[26].

Questo standard impone di dare centrale importanza alle differenti esigenze che caratterizzano i bambini e i ragazzi, inclusi quelli con disabilità, a seconda della loro età e fase di sviluppo, per garantire che l’utente fruisca di un servizio adeguato alla propria età e capacità di discernimento. Assieme al principio del superiore interesse, esso costituisce il senso profondo del Codice, non a caso denominato “Age appropriate design code”[27].

La verifica dell’età dell’utente è essenziale anche per garantire il rispetto dell’età del c.d. consenso digitale (art. 8 del GDPR) ed evitare di svolgere trattamenti illeciti. Nel Regno Unito, quest’età è fissata al minimo previsto dal GDPR: 13 anni[28]. Per verificare l’età con adeguato livello di certezza, a seconda delle specificità del caso, possono prevedersi diverse modalità (es. autodichiarazioni, richieste di documenti d’identità o strumenti basati sull’intelligenza artificiale). La verifica dell’età, spesso, implica a sua volta trattamenti di dati e deve essere progettata e gestita nel rispetto della normativa in materia di privacy.

Per agevolare gli operatori nel comprendere capacità e bisogni che caratterizzano i minori nel corso del loro sviluppo, l’ICO ha predisposto un’apposita tabella strutturata per fasce d’età (Children’s code, Annex B).

Trasparenza

Questo standard impone che le informazioni fornite agli utenti in materia di privacy o di altro tipo (termini di utilizzo, policy ecc.) siano concise, evidenti e redatte con un linguaggio chiaro e adatto all’età del minore. Gli operatori sono tenuti a fornire spiegazioni contestuali aggiuntive su come i dati personali verranno utilizzati nel momento in cui è previsto l’utilizzo di tali dati[29].

Questo precetto specifica i doveri di trasparenza verso i minori già previsti dall’art. 12 del GDPR e approfonditi nelle Linee guida sulla trasparenza del Gruppo di lavoro art. 29[30].

Sono modalità di fornitura delle informazioni adatte ai bambini quelle sotto forma di cartoni animati, i contenuti audio, video, interattivi o basati sulla gamification, nonché ogni altro mezzo idoneo ad attrarre l’attenzione del destinatario.

Le informazioni devono essere fornite in più versioni, differenziate a seconda della fascia d’età del minore, e devono essere presenti anche versioni per adulti. Adulti e bambini devono poter leggere tutte le versioni disponibili – ciò, anche per consentire all’utente di individuare la versione più comprensibile per lui. A seconda dell’età e del livello di rischio, potrebbe essere necessario invitare il bambino a parlare o a richiedere il supporto di un adulto prima di attivare funzioni che prevedono nuovi trattamenti.

Gli operatori possono trovare nella sezione dedicata a questo standard un’apposita tabella di supporto, con indicazioni sulle modalità di fornitura delle informazioni più idonee a seconda della fascia d’età dell’utente.

Usi dei dati dannosi

I dati personali dei minori non possono essere utilizzati con modalità che è stato dimostrato essere dannose per il loro benessere o che risultano in contrasto con codici di settore, altre linee guida o con quanto consigliato dall’Autorità pubblica[31].

Coerentemente al considerando 2 del GDPR, il quale prevede che il Regolamento mira a contribuire al benessere delle persone fisiche, questo standard vieta di trattare i dati con modalità nocive per la salute fisica o psichica dei minori e il loro benessere.

Gli operatori sono tenuti a un approccio prudente: sono infatti vietate anche le modalità di trattamento per cui sia stata formalmente espressa la necessità di ulteriori studi volti a comprenderne l’eventuale nocività per i minori. Ad esempio, attualmente potrebbero essere giudicate in contrasto con il principio di correttezza le tecniche per estendere il coinvolgimento degli utenti (c.d. sticky-features, es. funzioni di “auto-play” data-driven, premi personalizzati in caso di ulteriore sessione di gioco ecc.).

Policy e standard delle community

Questo standard impone ai fornitori di rispettare i propri termini, policy e standard della comunità pubblicati (inclusi privacy policy, limiti di età, regole di comportamento e politiche sui contenuti)[32].

Semplicemente: si è responsabili di ciò che si dichiara. Ad esempio, se il sito vieta atti di bullismo, devono essere implementate misure idonee a fronteggiare questi fenomeni; se si dichiara il sito adatto ai minori, occorre predisporre quanto necessario per neutralizzare con efficacia le condotte inadeguate.

Impostazioni predefinite

Questo standard impone di configurare le impostazioni, in modo predefinito (by default), nel modo che sia più rispettoso della privacy, a meno che sia possibile dimostrare la presenza di una ragione cogente tale da giustificare una differente configurazione, in considerazione del superiore interesse del minore[33].

Il concetto di privacy by default ha un’importanza particolare nel contesto della tutela del minore online, perché i minori – specialmente quelli afferenti a fasce d’età più basse –in genere non modificano le impostazioni predefinite dei servizi utilizzati.

Gli operatori sono tenuti a implementare impostazioni privacy, cioè funzioni che consentano all’interessato di esercitare un potere di scelta sui propri dati, ogni qual volta ciò sia possibile, ad esclusione dei trattamenti imprescindibili per il funzionamento base del servizio. Ne deriva che queste impostazioni devono essere previste rispetto a ogni elemento del servizio aggiuntivo rispetto a quello “base”.

Le impostazioni di default devono garantire che i dati del minore non siano visibili o disponibili agli altri utenti del servizio o a terzi, né siano usati dal fornitore per scopi diversi dalla fornitura del servizio base (es. di default, sono vietati i servizi opzionali di personalizzazione). Le uniche eccezioni sono la sussistenza di ragioni cogenti (es. trasmettere i dati all’Autorità giudiziaria per prevenire reati) o la modifica delle impostazioni privacy ad opera dell’interessato. In merito a quest’ultimo punto:

- quando l’utente prova a modificare le impostazioni, occorre fornire informazioni di tipo contestuale per chiarire le conseguenze derivanti dalla modifica (vd. par. 3.4. sulla trasparenza);

- salvo casi particolari, deve essere sempre offerta la possibilità di scegliere tra l’applicazione della nuova configurazione in via permanente o per quella sola specifica sessione;

- in caso di aggiornamenti software, occorre conservare le scelte dell’utente e, se ciò non risulta possibile, occorre configurare le impostazioni predefinite nel modo più rispettoso della privacy.

Per i servizi utilizzabili da più utenti (eventualmente di diversa età), occorre prevedere la possibilità di creare più profili, per consentire a ogni utente di fruire del servizio con le proprie impostazioni privacy.

Minimizzazione dei dati

Questo standard impone di raccogliere e conservare solo i dati personali strettamente necessari per fornire gli specifici elementi (o funzioni) del servizio che il minore sta utilizzando in modo attivo e consapevole. I minori devono poter compiere scelte separate sugli elementi che desiderano attivare[34].

Lo standard, in sostanza, impone il rispetto dei principi di minimizzazione e di limitazione della finalità previsti dall’art. 5 GDPR, specificandoli nel contesto dei servizi online utilizzati dai minori.

Condivisione dei dati

I dati personali dei minori non devono essere condivisi se non si è in grado di dimostrare che sussiste una ragione cogente per farlo, in considerazione del superiore interesse del minore[35].

Il concetto di condivisione dei dati su cui si basa il precetto è, in sostanza, sovrapponibile a quello di “destinatario” previsto dall’art. 4, n. 9) del GDPR: la condivisione comprende ogni forma di comunicazione o messa a disposizione del dato ad altri soggetti e persone, anche se appartenenti al medesimo ente.

Prima di comunicare i dati, occorre ottenere garanzie sul fatto che il destinatario non li utilizzerà con modalità dannose per il benessere del minore, nonché svolgere verifiche di due diligence sull’adeguatezza delle pratiche di protezione dei dati del destinatario e su ogni ulteriore comunicazione dei dati.

Gli esempi dell’ICO sono significativi: è certamente ragione cogente che consente la comunicazione, la necessità di prevenire reati in danno del minore; al contrario, difficilmente potrebbe considerarsi tale la vendita dei dati di un minore per consentirne il riuso a fini commerciali.

Geolocalizzazione

Le impostazioni di geolocalizzazione devono essere spente per impostazione predefinita, a meno che sia possibile dimostrare la presenza di una ragione cogente tale da giustificarne l’attivazione by default, in considerazione del superiore interesse del minore. Quando il rilevamento della posizione è attivo, occorre che ciò sia esplicitato mediante un simbolo che sia chiaro per i minori. Le impostazioni che rendono la posizione del bambino visibile ad altri, di default devono essere disattivate al termine di ogni sessione[36].

Questo standard ha dignità autonoma per i rischi elevati che pone la geolocalizzazione del minore, attività che rende quest’ultimo più vulnerabile rispetto ai reati incidenti sulla sua sicurezza e integrità fisica.

Parental control

Quando sono utilizzati strumenti di parental control, occorre che il minore ne sia informato con modalità adeguate alla sua età. Durante il funzionamento degli strumenti che consentono di monitorare l’attività online o di localizzare la posizione geografica del minore, occorre informare quest’ultimo mediante un simbolo chiaramente comprensibile[37].

Con “parental control” normalmente ci si riferisce agli strumenti che permettono di impostare limiti all’attività online del minore (es. “filtri famiglia”) o di monitorarne la navigazione o la posizione. Questi strumenti incidono su diritti e libertà fondamentali (privacy e protezione dei dati, libertà di associazione, informazione, espressione ecc.) e, perciò, risulta essenziale spiegare chiaramente al minore il loro scopo ed informarlo quando gli stessi sono attivi, onde evitare chilling effect confliggenti con le esigenze di sviluppo della sua persona.

Profilazione

Le funzioni basate sulla profilazione devono essere spente per impostazione predefinita, a meno che sia possibile dimostrare la presenza di una ragione cogente tale da giustificarne l’attivazione by default, in considerazione del superiore interesse del minore. La profilazione può essere svolta solo in presenza di misure idonee a proteggere i minori da qualsiasi effetto dannoso (in particolare, dalla fornitura di contenuti dannosi per la loro salute o il loro benessere)[38].

Il GDPR prevede che i minori meritano una specifica protezione rispetto alla «creazione di profili di personalità» e che essi non possono essere oggetto di processi decisionali esclusivamente automatizzati[39]. I minori, infatti, «non sanno o non possono capire la logica delle decisioni algoritmiche» e «sono costretti a seguire le istruzioni fornite da macchine»[40]. Recentemente, i rischi della profilazione del minore sono stati evidenziati dal Comitato Europeo per la Protezione dei Dati, che ha evidenziato come essa può influenzare la formazione delle preferenze e degli interessi del bambino, incidendo sull’autonomia e lo sviluppo del medesimo[41]. A ogni modo, questo standard non vieta la profilazione, se conforme al Codice e al GDPR.

La profilazione che è parte delle funzioni base del servizio potrà essere attiva anche di default; per gli elementi aggiuntivi, invece, la profilazione potrà essere attiva soltanto in caso di modifica dell’impostazione privacy dedicata. Impostazioni di questo tipo, dunque, devono essere previste per tutte le ipotesi di profilazione non attinente ai servizi base (in merito, l’ICO ha ritenuto che la profilazione per fini di pubblicità comportamentale solo eccezionalmente potrebbe ritenersi parte del servizio base).

Altro aspetto di primaria importanza è che il fornitore del servizio è responsabile per i contenuti delle raccomandazioni personalizzate o dei comportamenti suggeriti in base alla profilazione. L’estensione della responsabilità del fornitore ai contenuti proposti deriva dal fatto che, questi ultimi, sono la risultante del trattamento di dati che il fornitore ha deciso di effettuare e di cui risponde giuridicamente. Ne deriva che se il fornitore non è in grado di predisporre misure atte ad evitare che siano raccomandati contenuti o suggeriti comportamenti dannosi per il minore (es. pornografia), la profilazione risulta vietata.

Tecniche per influenzare il comportamento dell’utente

Questo standard vieta di utilizzare le tecniche per influenzare il comportamento dell’utente (c.d. nudge techniques) allo scopo di indurre o incoraggiare i minori a fornire dati personali superflui o a disattivare le protezioni privacy[42].

Le tecniche vietate sono tutte quelle utilizzate per influenzare il processo decisionale dell’utente per gli scopi anzidetti (es. pulsante per prestare il consenso al marketing con dimensioni più grandi e colori più accattivanti di quello per negarlo). Sono vietate anche le tecniche che rendono la scelta dell’opzione privacy migliore più difficoltosa o dispendiosa in termini temporali di quelle meno vantaggiose (es. richiedendo un numero di clic maggiori). Il principio di correttezza del trattamento e la neutralità tecnologica dello standard impediscono qualsiasi tecnica avente l’effetto indicato, a prescindere dalle modalità con cui questo effetto è ricercato (es. facendo leva sul linguaggio, su aspetti grafici, sonori, di processo ecc.).

Questo standard ha centrale importanza per garantire l’effettività del Codice e la reale protezione del minore nell’ambiente online. I divieti che pone rafforzano i precetti della privacy by default, evitando che gli stessi siano sostanzialmente annullati mediante pratiche subdole (es. gioco online offerto di default senza profilazione, in cui l’esperienza di gioco viene interrotta frequentemente da un fastidioso pop-up che, con espressioni allarmanti, ricorda all’utente gli svantaggi di giocare senza personalizzazione, incitandone l’attivazione mediante clic su un apposito pulsante).

Gli operatori, tuttavia, non dovranno abbandonare le nudge techniques, bensì “riconvertirle”: queste tecniche, infatti, possono essere un utile supporto per garantire al minore un ambiente online sicuro, specialmente per i bambini più piccoli; la necessità di considerare il superiore interesse di questi ultimi, a fronte dei limiti delle loro capacità cognitive e abilità decisionali, potrebbe imporre di preferire l’uso di tecniche che spingano il bambino verso le impostazioni privacy più sicure, rispetto ad altre modalità (es. la fornitura di spiegazioni chiare, che rischierebbero comunque di non essere comprese).

Smart toys e altri dispositivi connessi

I fornitori di smart toys o altri dispositivi connessi devono assicurarsi di includere strumenti efficaci per garantire la conformità al Codice[43].

Sono oggetto di questo standard i giochi o gli altri dispositivi fisici connessi a Internet (es. un peluche che registra la voce del bambino e la trasmette a un server che fornirà, in risposta, un messaggio personalizzato; una fascetta sportiva che registra le informazioni sull’attività fisica dell’utente su un server, affinché l’utente possa accedervi mediante apposita app).

I fornitori di questi dispositivi devono indicare chiaramente che gli stessi prevedono l’utilizzo dei dati personali, sia prima dell’acquisto (preferibilmente sulla confezione del prodotto) sia al momento dell’installazione. In particolare, prima dell’acquisto devono essere rese disponibili sia l’informativa privacy sia la restante documentazione legale.

Devono essere presenti funzioni che rendano evidente quando il dispositivo tratta dati (es. una spia che si accende quando è in corso la registrazione vocale). Anche la modalità di ascolto deve essere debitamente segnalata e, durante la stessa, non devono essere raccolti dati personali. Essenziale, poi, è prevedere funzioni che permettano agevolmente la disattivazione della raccolta dei dati o della modalità di ascolto (es. un pulsante), rendendo possibile l’uso come dispositivo non connesso.

Il fornitore del dispositivo fisico è responsabile per il rispetto delle norme privacy anche se le funzioni online sono esternalizzate a un terzo e, in tal caso, deve anche accertarsi che il terzo rispetti tali norme.

Strumenti online

Questo standard impone di fornire strumenti evidenti e accessibili per agevolare i minori nell’esercizio dei diritti in materia di protezione dei dati personali e nella segnalazione di problemi[44].

L’ultimo standard del Children’s code ha lo scopo di rendere semplice, per i ragazzi, esercitare i propri diritti privacy, presentare reclami o segnalare problemi, in linea con le prescrizioni dell’art. 12, par. 2 del GDPR.

I fornitori, anzitutto, devono individuare le modalità più idonee per assicurare che l’utente sia consapevole dei propri diritti e del contenuto di questi, progettando soluzioni differenziate in base all’età. Gli strumenti devono essere evidenti e l’utente deve essere posto nelle condizioni di fruirne senza effettuare faticose ricerche. In particolare, gli strumenti online dovrebbero essere specifici per ogni diritto previsto dal GDPR: ad esempio, deve essere presente una funzione per scaricare tutti i dati e, quindi, esercitare i diritti di accesso e alla portabilità, altra per curarne la correzione consentita dal diritto di rettifica e così via.

Rispetto agli strumenti per segnalare problemi o presentare reclami, l’obbligo di agevolare l’interessato impone di prevedere funzioni che consentano di tracciare lo stato del reclamo, di rendere manifesta l’urgenza del medesimo e di inserire informazioni aggiuntive, permettendo all’utente di manifestare le proprie esigenze e al fornitore di assegnare la corretta priorità alla segnalazione. Questo aspetto rileva anche rispetto al diritto del minore a essere ascoltato nelle questioni che lo riguardano e consente agli operatori di limitare fraintendimenti nell’uso delle impostazioni privacy messe a disposizione dell’utente.

Note

- L’adozione del Children’s code è prevista dal Data Protection Act 2018, sec. 123. ↑

- Children’s code, cit., 5. ↑

- Così nelle FAQ sul Children’s code pubblicate dall’ICO, disponibili al seguente indirizzo: https://ico.org.uk/for-organisations/age-appropriate-design/additional-resources/faqs-the-basics (consultato in data 5 ottobre 2020). ↑

- Considerando 75 del GDPR. Su quest’aspetto, si veda anche: Gruppo di lavoro art. 29, Linee guida in materia di valutazione d’impatto sulla protezione dei dati e determinazione della possibilità che il trattamento “possa presentare un rischio elevato” ai fini del regolamento (UE) 2016/679, versione emendata adottata il 4 ottobre 2017, 11. ↑

- Ci si riferisce ai doveri stabiliti, a livello interno, dall’art. 30 Cost. e dagli artt. 147 e 315-bis c.c., nonché, in ambito sovranazionale, dall’art. 18 della Convenzione di New York sui diritti del fanciullo del 20 novembre 1989 (ratificata dall’Italia con l. 176 del 27 maggio 1991). ↑

- Information Commissioner’s Office, Age appropriate design: a code of practice for online services, 10 (nel seguito citato come “Children’s code”). ↑

- Children’s code, cit., 10-11. La conformità al Codice è strumentale anche al rispetto del riformato Data Protection Act 2018, nonché della normativa del Regno Unito sulla privacy nelle comunicazioni elettroniche (“The Privacy and Electronic Communications (EC Directive) Regulations 2003”, c.d. PECR). ↑

- Ivi. ↑

- Children’s code, cit., 5. ↑

- Children’s code, cit., 13 e 23. ↑

- Children’s code, cit., 15-19. ↑

- L’ambito di applicazione materiale del Children’s code è previsto dal Data Protection Act 2018, sec. 123. ↑

- La definizione dei servizi della società dell’informazione, inizialmente prevista dalla direttiva 98/34/CE (modificata dalla direttiva 98/48/CE), si rinviene attualmente all’articolo 1, par. 1, lett. b), direttiva (UE) 2015/1535, che ha abrogato la prima direttiva citata. ↑

- Children’s code, cit., 93. ↑

- Si veda il Data Protection Act 2018, sec. 127(1), (3) e (4). ↑

- Children’s code, cit., 12. ↑

- Children’s code, cit., 12. ↑

- Children’s code, cit., 84-87. ↑

- Children’s code, cit., 24-26. ↑

- L’art. 3, par. 1 della Convenzione prevede che «In tutte le decisioni relative ai fanciulli, di competenza sia delle istituzioni pubbliche o private di assistenza sociale, dei tribunali, delle autorità amministrative o degli organi legislativi, l’interesse superiore del fanciullo deve essere una considerazione preminente». Il precetto in esame è stabilito anche all’art. 24, par. 2 della Carta dei diritti fondamentali dell’Unione europea. Il Gruppo di lavoro art. 29 (oggi sostituito dal Comitato Europeo per la Protezione dei Dati), evidenziava la centralità del principio del superiore interesse del minore già nel 2008 (“Working Document 1/2008 on the protection of children’s personal data”, 18 febbraio 2008, pag. 4), mentre nel 2009 tornava a ribadirne l’importanza nello specifico contesto dei social network (“Opinion 5/2009 on online social networking”, 12 giugno 2009, 11). ↑

- Committee on the Rights of the Children, “General comment No. 14 (2013) on the right of the child to have his or her best interests taken as a primary consideration (art. 3, para. 1)”, 29 maggio 2013, 16. ↑

- Children’s code, cit., 24. ↑

- Children’s code, cit., 27-31. ↑

- L’elenco adottato dall’ICO ai sensi dell’art. 35, par. 4 del GDPR, assieme a esempi pratici, è disponibile al seguente indirizzo: https://ico.org.uk/for-organisations/guide-to-data-protection/guide-to-the-general-data-protection-regulation-gdpr/data-protection-impact-assessments-dpias/examples-of-processing-likely-to-result-in-high-risk/ (consultato in data 5 ottobre 2020). ↑

- Garante per la protezione dei dati personali, Elenco delle tipologie di trattamenti, soggetti al meccanismo di coerenza, da sottoporre a valutazione d’impatto, Allegato 1 al provvedimento n. 467 dell’11 ottobre 2018. ↑

- Children’s code, cit., 32-36. ↑

- Il Data Protection Act 2018, sec. 123(4)(a), ha imposto all’ICO di redigere il Codice considerando le diverse esigenze del minore a seconda della sua età. ↑

- Data Protection Act 2018, sec. 9. In Italia, l’art. 2-quinquies del riformato d.lgs. 196/2003 ha previsto il limite dei 14 anni. ↑

- Children’s code, cit., 37-42. ↑

- Gruppo di lavoro art. 29, Linee guida sulla trasparenza ai sensi del regolamento 2016/679, versione emendata adottata l’11 aprile 2018. ↑

- Children’s code, cit., 43-46. ↑

- Children’s code, cit, 47-48. ↑

- Children’s code, cit., 49-52. ↑

- Children’s code, cit., 53-55. ↑

- Children’s code, cit., 56-57. ↑

- Children’s code, cit., 58-60. ↑

- Children’s code, cit., 61-63. ↑

- Children’s code, cit., 64-71. ↑

- Considerando 38 e 71 del GDPR. ↑

- Queste parole sono di Giovanni Buttarelli (Privacy 2030: una nuova visione per l’Europa, Garante per la protezione dei dati personali – International Association of Privacy Professionals, 2020, 12). ↑

- Comitato Europeo per la Protezione dei Dati, Guidelines 8/2020 on the targeting of social media users, versione 1.0 adottata il 2 settembre 2020, 7. Sul rapporto tra profilazione e minori, si veda anche: Gruppo di lavoro art. 29, Linee guida sul processo decisionale automatizzato relativo alle persone fisiche e sulla profilazione ai fini del regolamento 2016/679, versione emendata e adottata in data 6 febbraio 2018, 31-33. ↑

- Children’s code, cit, 72-76. ↑

- Children’s code, cit., 77-79. ↑

- Children’s code, cit., 80-83. ↑