La tecnologia di riconoscimento facciale (facial recognition technology, o FRT) viene già impiegata in Europa e nel Mondo dalle forze dell’ordine e spesso si basa su algoritmi, intelligenza artificiale machine learning.

Il Comitato europeo per la protezione dei dati (EDPB) ha quindi emesso le linee guida 5/2022, con lo scopo di effettuare una valutazione sull’impiego di queste tecnologie e sul contemperamento dei vari interessi in gioco, diritti umani su tutti, offrendo agli Stati membri dell’UE un documento sulla base del quale valutare le proprie scelte legislative.

Non tutto è permesso, anche se c’è in gioco la sicurezza pubblica.

L’interesse per le FRT, infatti, è sia privato che pubblico.

Da un lato, infatti, sono tecnologie con rilevanza economica enorme; il business promette di muovere miliardi di euro.

Dall’altro, le autorità pubbliche potrebbero impiegare le FRT per finalità di sicurezza pubblica e contrasto al crimine ed al terrorismo; da qui l’esigenza di un documento dell’EDPB per dare una indicazione univoca agli Stati UE.

Indice degli argomenti

Le linee guida

L’ EDPB ha approfondito molto le problematiche che le FRT pongono intrinsecamente dal punto di vista tecnologico.

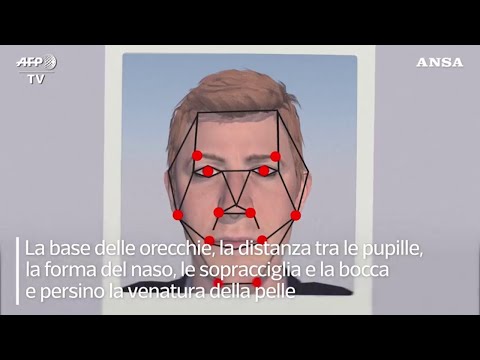

In primo luogo, sono algoritmi che trattano dati biometrici che possono essere impiegati sia per l’autenticazione che per l’identificazione di un soggetto.

Il primo utilizzo è quello – comunissimo – degli smartphone, che consentono lo “sblocco” del telefono o l’autorizzazione di alcune operazioni (ad esempio quelle bancarie) attraverso il riconoscimento facciale (facial id).

Il secondo serve ad indentificare un soggetto sulla base del volto; questo secondo impiego, peraltro, si presta a numerose applicazioni in termini di sicurezza pubblica.

Va però precisato che la distinzione proposta dall’EDPB non è così netta: ci sono applicativi FRT che vengono utilizzati contemporaneamente per l’identificazione e per l’autenticazione (ad esempio per l’accesso a determinati ambienti e per il pagamento diretto senza contante o cara di credito).

L’EDPB osserva, poi, spesso che le FRT possono determinare seri rischi per i diritti delle persone perché anche un piccolo errore sul piano dell’algoritmo può determinare conseguenze indesiderate.

Resta il punto dell’uso nel settore penale, che impatterebbe comunque sui diritti previsti dagli articoli 7 e 8 della Carta dei Diritti Fondamentali dell’Unione Europea.

Non solo: l’idea che le autorità pubbliche possano raccogliere dati biometrici che consentono di effettuare catalogazioni per categorie etniche, razziali, religiose o politiche potrebbe determinare la compressione dei diritti previsti dagli articoli 1, 10, 11 e 12 della Carta dei Diritti Fondamentali dell’Unione Europea.

Ai sensi dell’articolo 52 della Carta dei Diritti Fondamentali dell’Unione Europea, qualsiasi limitazione all’esercizio dei diritti fondamentali devono essere previste per legge, rispettare “l’essenza” del diritto compresso è, comunque, rispettare rigorosamente il principio di proporzionalità.

Non solo: il citato articolo 52 richiede che il legislatore individui la base giuridica e le modalità di esercizio del proprio potere discrezionale.

Le possibili violazioni degli Stati

L’EDPB ha quindi individuato alcune delle possibili violazioni che uno Stato membro potrebbe compiere nella regolamentazione dell’uso delle FRT.

Si tratta, soprattutto, di limitazioni indiscriminate ed effettuate a prescindere da una condotta individuale; di difficoltà nell’accesso alla giustizia mediante normative processuali eccessivamente complesse; di ipotesi di data retention incontrollato e per un periodo di tempo non definito e, infine, do un impiego non conforme a diritto dei metadati raccolti.

L’EDPB ha anche preso in considerazione il disposto dell’articolo 53 della Carta dei Diritti Fondamentali dell’Unione Europea, che prevede la corrispondenza – almeno – tra i diritti sanciti dalla carta stessa ed i diritti posti dalla Convenzione Europea per i Diritti dell’Uomo.

Quindi, l’impiego delle FRT potrebbe essere previsto da una normativa nazionale o europea solo nei limiti della stretta necessità, impattando nel minor modo possibile sulla vita dei singoli, con controlli strettissimi e sotto la sorveglianza delle autorità garanti.

Conclusioni

Il documento, in sé e per sé considerato, è una pregevole sintesi delle normative e degli arresti giurisprudenziali in materia di data retention e impiego di dati biometrici, fino alle conclusioni, dove l’EDPB ha individuato davvero il punto nevralgico della questione.

Al paragrafo 101 si legge che “L’EDPB comprende la necessità che le autorità incaricate dell’applicazione della legge traggano vantaggio dal miglior possibile strumenti per identificare rapidamente gli autori di atti terroristici e altri reati gravi. Tuttavia, tali strumenti dovrebbero essere utilizzati nel rigoroso rispetto del quadro giuridico applicabile e solo nei casi in cui essi soddisfino i requisiti di necessità e proporzionalità, come previsto dall’articolo 52, paragrafo 1, della Carta. Inoltre, sebbene le moderne tecnologie possano essere parte della soluzione, non sono affatto un proiettile d’argento”.

Non solo: l’EDPB ha chiesto il general ban dell’impiego delle FRT in contesti pubblici, in modo indiscriminato e in tutti i casi in cui queste tecnologie possono determinare la classificazione di individui per sesso, razza, religione o appartenenza politica, esprimendo la massima preoccupazione per le tecnologie che riescono anche a determinare lo stato d’animo di un soggetto a partire dalla fisionomia e fisiologia del viso.

Purtroppo, non è tutto oro quel che luccica: tra gli impieghi consentiti l’EDPB indica, nell’Allegato III, il riconoscimento facciale alle frontiere, in connessione con i documenti dell’interessato (ad esempio il passaporto).

La tutela di quest’ultimo sarebbe garantita da una verifica umana successiva in caso di errore dell’algoritmo.

Altro scenario ipotizzato è l’impiego della FRT per le ipotesi di sottrazione di minori: in questo caso l’impiego dei dati servirebbe a “recuperare” minori rapiti e la tutela del diritto alla riservatezza sarebbe garantita mediante l’impiego di personale specializzato e con la cancellazione dei dati del minore stesso una volta cessata la necessità di cercarlo.

Il terzo scenario proposto è l’impiago delle FRT per il riconoscimento dei soggetti coinvolti in contesti di manifestazioni violente: dato che in questi casi spesso vengono impiegate le riprese di telecamere a circuito chiuso, non vi sarebbero grandi novità, salvo che non siano le telecamere stesse ad essere dotate di FRT.

Il quarto scenario proposto vede la ricerca giudiziale di un soggetto sospettato di aver commesso un reato ed il cui volto sia stato già ripreso da una telecamera; in questo caso l’uso delle FRT sarebbe consentito per verificare la corrispondenza tra il viso ripreso ed i database delle forze dell’ordine.

Il quinto scenario è decisamente inquietante: la polizia di uno Stato membro compila una watchlist di soggetti ricercati e si pone con un mezzo – ad esempio un furgone – in una zona con molto traffico di pedoni (ad esempio all’entrata di un centro commerciale molto frequentato).

Qui confronta i volti delle persone che entrano ed escono con quelli della watchlist mediante una FRT.

Fortunatamente, almeno questo scenario viene ritenuto del tutto in contrasto con il diritto dell’Unione.

Personalmente trovo che anche il primo scenario sia seriamente preoccupante, ma più sul piano politico che giuridico: sul punto, l’analisi dell’EDPB pare equilibrata.

Ammettere, tuttavia, che si possano inserire le FRT alle frontiere o negli aeroporti significa comunque “aprire” alla società di controllo di massa e introdurre un tassello del modello cinese di sorveglianza: sul punto, spetta alle forze politiche ed ai cittadini chiedersi che Europa vogliono.